【论文】Densely connected multidilated convolutional networks for dense prediction tasks

论文题目:Densely connected multidilated convolutional networks for dense prediction tasks

作者:Naoya Takahashi, Yuki Mitsufuji

会议/时间:CVPR2021

论文目标

在密集预测任务中,模型通常需要处理和学习非常大范围的上下文信息,为了满足这一需求,常用的方法包括增加模型的深度(例如Resnet和DenseNet)、增加模型的宽度(例如Inception)。一种效果比较好的方式是增加短路链接使得低层特征能够传递到比较高的卷积层中,因此在ResNet的基础上有了DenseNet。更深的网络具有的优点是高层的卷积模块具有更大的感受野,从而可以学习到更大范围的上下文信息。但是更深的网络通常比较难以训练。为了增大感受野而不增加深度,常用的方法包括空洞卷积,使用注意力机制,使用特征金字塔网络等。

为了进一步提升在密集预测任务上的效果,作者将空洞卷积引入了DenseNet中,并且设计了D2-Block模块和D3Net网络,消除简单使用空洞卷积可能会引入的混淆问题,并在图像分割和语音讲话人分离两个任务上测试,取得了不错的效果。

相关工作

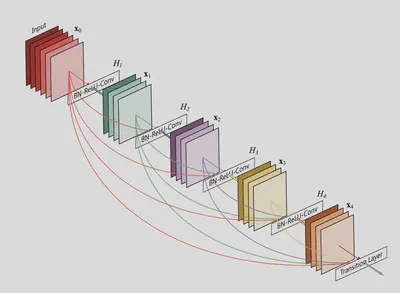

在DenseNet中,使用了稠密的短路链接,每一层卷积层的输入都是之前的所有卷积层的输出,充分利用了不同尺度的特征图的信息,从而学习到输入数据在不同尺度上的信息。同时也增加了丰富的梯度流,使得模型能学到更丰富的信息。

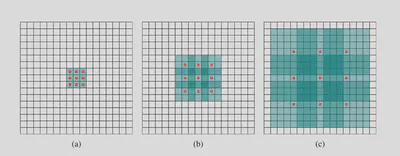

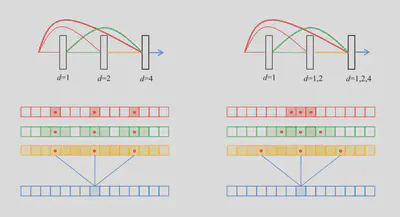

在空洞卷积或者说膨胀卷积中,在计算卷积操作的时候为卷积核之间填充了0,从而能显著的增加感受野。考虑到使用相同的膨胀因子导致的网格效应,可以采用HDC的思路,选择若干层为一组,组内使用逐渐增大的膨胀因子,使用多组连接得到完整的网络。

本文方法

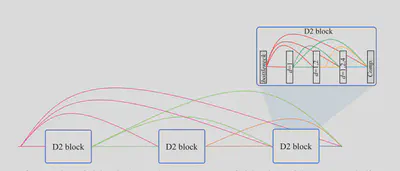

设计了一个将空洞卷积引入稠密卷积模块的方法,从而设计了D2-Block和D3Net。

在设计D2-Block的时候,直接将空洞卷积引入了DenseNet的Dense-Block中,此时由于增加了稠密连接,最后一层使用膨胀因子为4的空洞卷积时,其感受野之间出现了盲区,可能会丢失一些局部的信息。

因此文章中提出了混合膨胀因子的空洞卷积,也就是较高层的卷积层在计算空洞卷积的时候,对于不同层输入的特征图使用不同的膨胀因子,从而避免了上述的盲区,捕捉到更多的信息。

文章中将上述的D2-Block通过稠密连接相组合得到D3-Block。同时使用HDC的思路来设置参数,每一组内的膨胀系数都是互素而且逐渐增加的,同时多次重复来实现锯齿形的膨胀因子。

同时参考DenseNet的设计,在每一个D2-Block的前后都设计了Bottleneck和Compress模块,从而避免模型中的通道数量无限制的增加。

实验结果分析

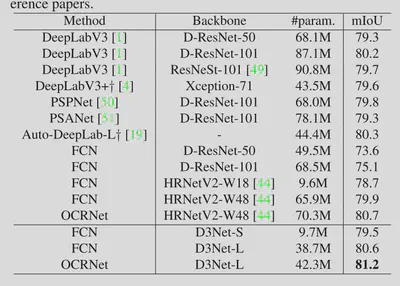

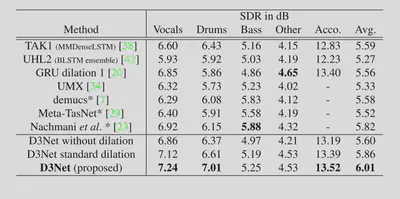

文章中进行了两组密集预测任务的实验,分别是语义分割和音频源分离。

在第一个任务中使用CityScapes数据集。

第二个任务使用MUSDB18数据集。

总结

将空洞卷积引入了DenseNet中。提出了混合膨胀因子的空洞卷积。